Um carro autônomo “enxerga” caixas. Paralelepípedos verticais e horizontais, azuis, verdes ou amarelos. Para ele são pedestres, carros, obstáculos da cidade. Já as ruas, faixas, semáforos, placas e calçadas são linhas coloridas. É a representação gráfica do ambiente que nós, humanos, construímos, alimentando o “cérebro” do carro com imagens do mundo real que o ajudam a construir seu mundo virtual, dando-lhe as ferramentas para interpretá-lo.

LEIA MAIS: Confira 5 coisas que carro autônomo fará por você no futuro

Essa capacidade determinará se os carros autônomos se tornarão parte do cotidiano. Quanto mais sofisticada a representação, mais poderão circular no trânsito urbano. Pois uma coisa é rodar em rodovias, outra é enfrentar cruzamentos com carros, motos e pedestres, ou rotatórias com várias saídas.

E, pior, convivendo com veículos guiados por humanos imprevisíveis . É o próximo passo na inteligência artificial sobre rodas. Como os carros autônomos vão lidar com tais situações? Quanto poderemos confiar neles?

ESCOLA PARA AUTÔNOMOS

O método de ensino na escola de veículos autônomos é o chamado deep learning (“aprendizado profundo”). Os alunos não são de carne e osso, mas robôs sobre rodas. Ainda crianças, têm conhecimento limitado. Mas aprendem rápido e nunca esquecem. O deep learning se baseia em redes neurais artificiais que imitam o sistema neurológico – um conjunto de cálculos na linguagem binária.

Isso permite aplicar lógicas probabilísticas em situações dinâmicas, explica Marco Pavone, o diretor do Laboratório de Sistemas Autônomos da Universidade de Stanford, Califórnia. “Suponha que um pedestre esteja prestes a atravessar a rua: os sistemas preditivos simples seguem o pressuposto de que continuará na mesma direção e velocidade. Mas as ações humanas variam, e as redes neurais permitem modelos mais aderentes ao comportamento humano”.

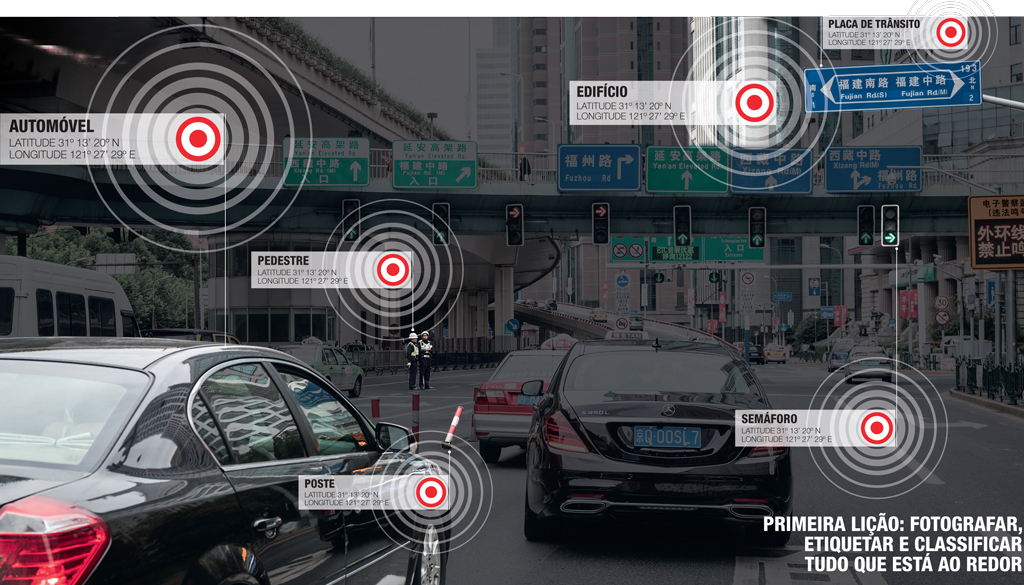

Assim, o treinamento dos carros-robô envolve três etapas. Pavone as resume: “A compreensão do ambiente, a previsão de como evoluirá e as decisões que a máquina deve tomar”. A primeira fase consiste em acumular filmes e fotos, que formam no “cérebro” do carro uma “biblioteca” de objetos, situações e comportamentos.

IMPLANTE DE MEMÓRIA

Você pode evocar o filme “Blade Runner”, mas o que os pesquisadores fazem, longe da manipulação de mentes pela Tyrell Corporation, está mais próximo do que fazem os pais ao mostrar à criança uma imagem e a ensinar a associar uma palavra. Alberto Broggi, professor na Universidade de Parma e diretor do VisLab, explica: “Ensinamos a máquina a criar uma representação tridimensional da realidade, que parte da identificação genérica de obstáculos para, em seguida, catalogá-los e identificá-los.

Vamos mostrar ao ‘robô’ um milhão de imagens de pedestres, com roupas diferentes, um com guarda-chuvas, outro com mochila, etc. Para cada imagem dizemos: é um pedestre. A máquina aprende com a experiência: quando vir um pedestre que nunca viu, o reconhecerá como tal.”

LEIA MAIS: O processo de automação dos carros nasceu há 80 anos, e parece não ter limites

Para esse ensino, é necessária uma coleção enorme de imagens de trânsito . A Mercedes, no programa Intelligent World Drive, rodou pelo mundo com um Classe S semiautônomo para filmar e fotografar situações reais de trânsito, da China aos EUA, da Índia à Austrália, gravando diferentes hábitos, práticas e leis de tráfego.

“Não importa só a quantidade de dados, mas a qualidade: buscamos situações extremas e cenários complexos. Queremos treinar os auto-robôs para prever o imprevisível”, explica Michael Hafner, chefe de desenvolvimento de condução autônoma da Mercedes-Benz.

Esses dados são todos processados manualmente: técnicos examinam as imagens e classificam os objetos. Aí tudo isso é carregado no cérebro do carro-robô. Ele “sobrepõe” esse conhecimento adquirido às imagens que “vê” quando circula com câmeras, radar e Lidar (sensor a laser). Na Vislab, como fez Elon Musk, apostam nas câmeras (integradas ao radar) e renunciam ao Lidar.

“Temos quatro câmeras para perto e oito de longo alcance, 150 metros, ambas estéreo – como dois olhos, que dão a percepção de profundidade. As imagens são registradas em alta definição – oito megapixels, 4k, 30fps (quadros por segundo), com mais informação do que pode dar um Lidar mais caro e delicado”, diz Broggi.

HUMANOS COMPLICADOS

A compreensão do ambiente avançou muito nos últimos anos. “Superou as expectativas”, exulta Hafner. O mais difícil vem agora. “Precisamos ensinar os auto-robôs a entender e prever os humanos”. Como? Expondo-os repetidamente a interações com humanos e explicando, como ensinamos a reconhecer pedestres e outros carros. “O método funciona em situações simples, como rotatórias”, explica Broggi. “Numa abordagem conservadora, o carro desacelera até parar, depois entra quando está livre.

Mas em uma típica rotatória italiana [ou brasileira], o risco é nunca passar. Estamos o treinando para quando vir um espaço entre dois carros tentar entrar – um comportamento mais próximo do visto em um motorista humano”. Pavone acrescenta: “Temos que achar um equilíbrio entre segurança e eficiência”.

LEIA MAIS: Veja 5 tecnologias que vão mudar o futuro dos carros

Não é questão apenas de algoritmos, mas também de capacidade de processamento. “Reconstruir graficamente o ambiente, para o carro ter a consciência sobre o que o rodeia, requer melhorias no processamento”, diz Mikols Kiss, da divisão de pré-desenvolvimento de autônomos da Audi. E acrescenta: “Felizmente há melhora contínua no poder de computação.

Uma centralina zFas do novo A8 tem mais capacidade que todo o sistema anterior. Monitora câmeras, sensores e radares e integra tudo em uma imagem 360o”. Hafner, da Mercedes, acrescenta: “Nas últimas décadas o poder de cálculo duplicou a cada dois anos. Há enorme potencial para o futuro”.

Por isso, apesar da prudência dos cientistas – segundo Broggi e Pavone, ainda podemos levar décadas para ter carros autônomos à prova de erros –, os fabricantes continuam otimistas. “Até 2021 teremos carros nível 4/5”, dizem na Mercedes (leia sobre os níveis de autonomia a seguir). “Nosso robô-táxi chega em 2022”, respondem na Renault.

Nessa corrida também está a Waymo, divisão do Google – e à frente de todos. Segundo o banco UBS, até 2030 ela terá 60% dos carros públicos autônomos (de um mercado de 26 milhões de veículos e US$ 2,8 trilhões). Que terão se tornado mais “inteligentes”. Nesse ponto, depois de treinar as máquinas a agir mais como homens, talvez os homens tenham de ter sido treinados a conviver mais com robôs. Dentro e fora dos carros.

No trânsito

A bordo do robô

O Lincoln MKZ cheio de câmeras e radares do Vislab, em Parma, Itália se aproxima da faixa para pedestres e desacelera para permitir a passagem de uma pessoa. Mais adiante, uma rotatória com dois veículos passando. O piloto em carne e osso no banco do motorista está ali só para intervir em caso de emergência.

Na tela do computador do técnico ao nosso lado, vemos o que o Lincoln vê: na frente do carro um retângulo vermelho avisa para parar; quando a rotatória fica livre, muda para verde e o carro anda. Aparece outro carro rápido, o Lincoln freia. Impacto evitado, sem o humano mexer um dedo. Fim do passeio. A condução tem a abordagem ultra-prudente – e isso precisa mudar para conviver com os humanos.

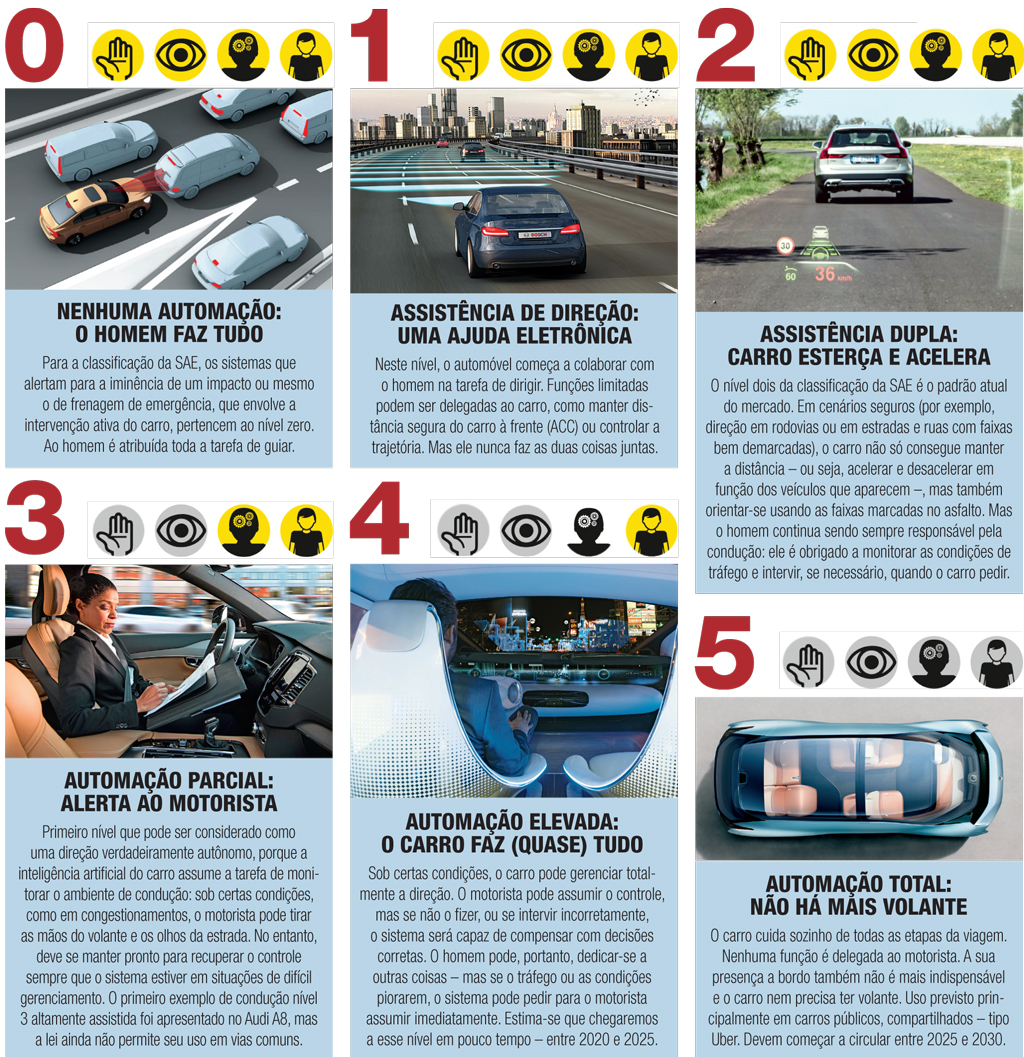

Seis níveis de autonomia

lhando os configuradores nos sites dos fabricantes, a coisa às vezes fica bastante complicada. Os crescentes recursos de assistência ao motorista não são classificados uniformemente. Cada marca escolhe o nome comercial que prefere. No fim, nem sempre sabemos o que exatamente o carro pode fazer com esses dispositivos.

A tentação de usar nomes cativantes é grande, mas sempre é bom lembrar que os consumidores não são tão cuidadosos para ler notas explicativas nos manuais sobre possibilidades e limites.

LEIA MAIS: Veículo autônomo promete entregar as compras na casa do cliente

Um caso famoso é o da Tesla, que chamou de Autopilot a combinação de ACC (controle de cruzeiro adaptativo) e assistente de manutenção em faixa. Certamente é uma boa ajuda para dirigir, mas está longe de ser “autopilot” – que acaba induzindo a esquecer a estrada e fazer outra coisa. Uma classificação independente é necessária, para dizer exatamente o que o carro é capaz de fazer e o que cabe ao motorista fazer.

Ela foi feita pela SAE, a associação americana de engenheiros automotivos, que preparou uma tabela com seis níveis – de zero (sem sistemas de auxílio) a cinco (sem volante). Nos primeiros três níveis dos carros autônomos, o motorista tem que controlar a situação, mesmo que o carro o livre de esterçar e acelerar; nos subsequentes, quem está atrás do volante pode fazer outras coisas (em certas áreas e sob certas condições).